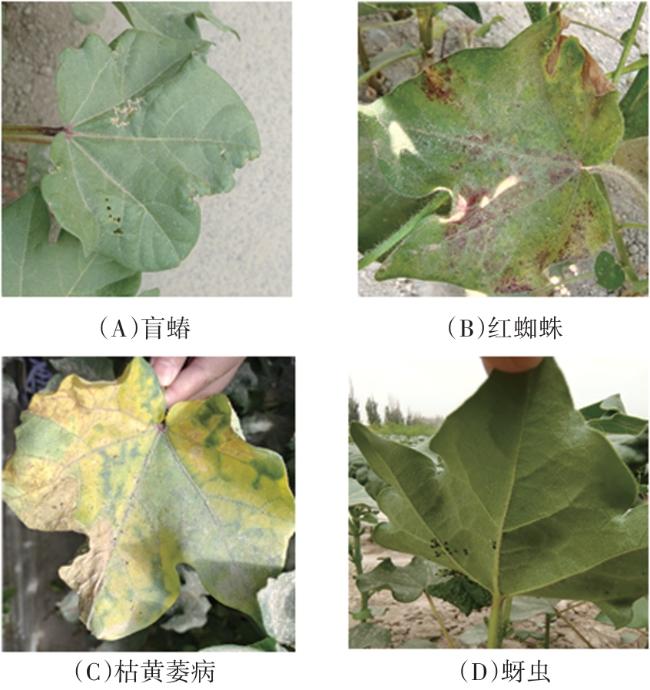

棉花作为主要经济作物之一,在新疆地区种植面积较大。该作物在生长过程中易遭受病虫害的侵害,进而影响其产量与品质。棉花病虫害具有种类多、危害大、发生频繁等特点

[1-2]。生产上,其病虫害种类识别以种植经验为主,以试验手段为辅,该方法成本较高、周期较长,因此,快速识别病虫害种类对于棉花安全生产具有重要意义。

图像处理技术发展迅速,被广泛应用于植物病虫害检测中。早期的处理手段需先对图像进行滤波、灰度化、二值化等预处理,以增强目标背景的信噪比

[3-4];随后提取颜色、纹理和形状等目标特征

[5-6];最后将提取特征与特征图库进行对比,或利用机器学习方法构建检测模型,如支持向量机

[7]、决策树

[8]、朴素贝叶斯

[9]、随机森林

[10]等。这些方法虽然具有较高的准确率,但流程较烦琐,同时鲁棒性较差。现阶段,随着深度学习研究的深入,相关学者将其应用于植物病虫害检测领域,汪志立等

[11]基于ResNet模型,通过加入注意力机制、更换激活函数等手段实现对小样本病虫害的识别,准确率达99.15%。张书贵等

[12]基于YOLOv8模型,构建多尺度多层级的网络结构,并基于Transformer设计注意力模块融合特征,在PV数据集上平均检测精度(

mAP)值达88.7%。王泰华等

[13]针对水稻害虫目标被物体遮挡以及害虫数量较多的问题,提出基于YOLOv5s模型,通过更换卷积单元、添加CBAM注意力机制,增强捕捉目标位置信息的能力,提升对目标区域的关注度,在水稻数据集上

mAP值达94.3%。刘鹏等

[14]针对桃病虫害特征小、不同病斑表征相似的问题,提出基于YOLOv7模型,该模型通过多尺度神经网络模型提升特征融合能力,对6种病虫害的

mAP值达93.2%。谭彬等

[15]通过融合Inception v3网络和RestNet网络提取的特征,实现柑橘的病虫害检测,对5种柑橘叶片识别准确率达98.49%。

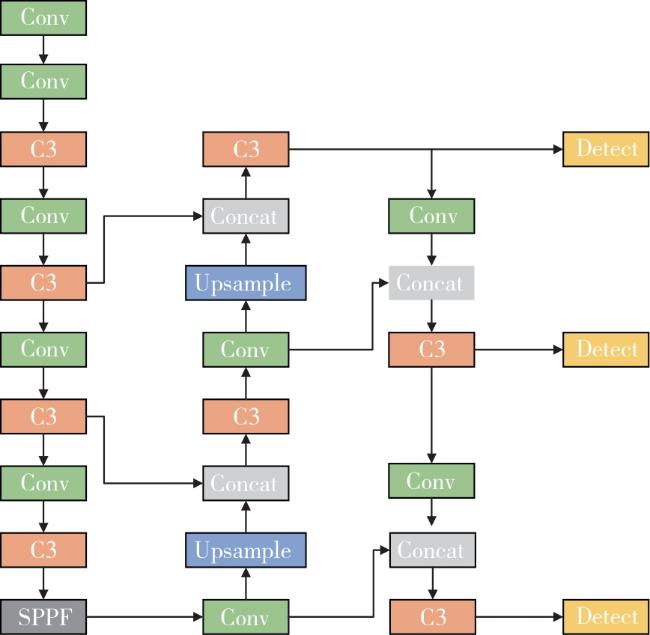

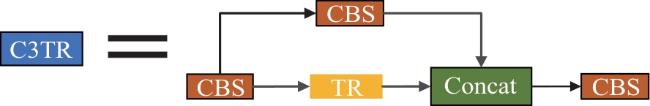

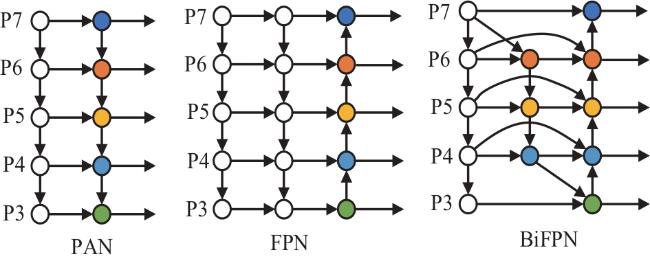

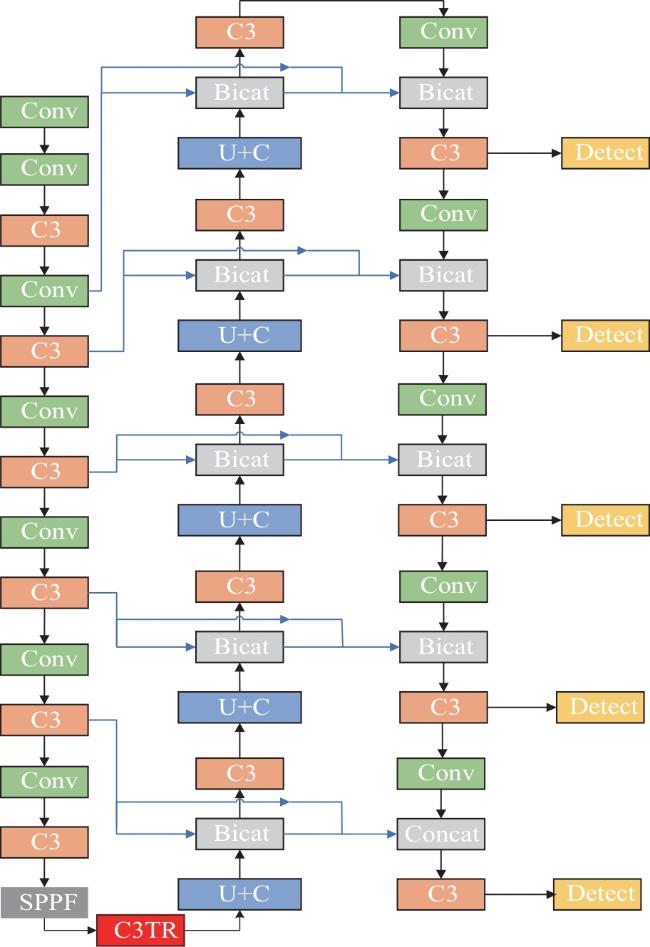

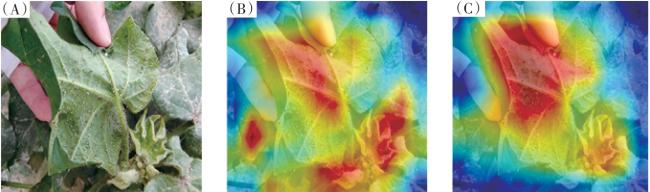

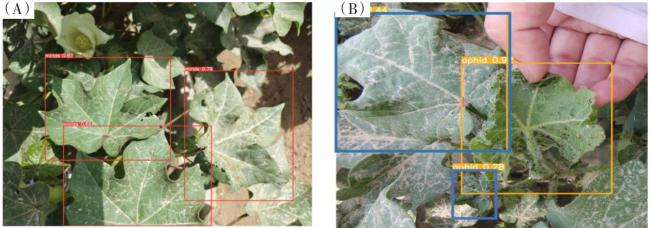

深度学习方法在病虫害识别领域应用效果明显。据此,本研究针对提升南疆棉花病虫害识别效率需求,提出基于YOLOv5s模型,通过构建多尺度特征提取网络(Multi-scale),利用BiFPN融合不同层级特征,以及添加注意力机制的方法改进模型,以实现棉花病虫害叶片的准确高效识别。